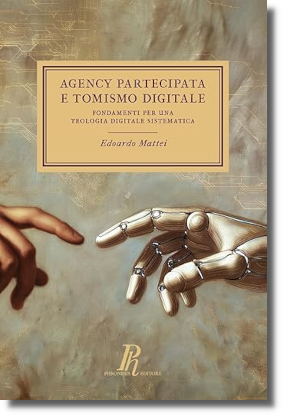

La domanda al centro del volume di Edoardo Mattei, Agency Partecipata e Tomismo Digitale. Fondamenti per una teologia sistematica digitale (Phronesis, Palermo 2026) è semplice da formulare, molto meno da rispondere: cosa è l’intelligenza artificiale? Non cosa fa, non come regolarla. Cosa è.

La risposta che Mattei costruisce in trecento e settanta pagine è che l’IA non è né uno strumento passivo né un agente autonomo. È un mediatore attivo che partecipa all’azione umana esercitando una causalità reale, pur rimanendo ontologicamente subordinato all’intelligenza e alla volontà che lo hanno prodotto.

L’autore chiama questa posizione «agency partecipata» e ne fa il cardine di un tentativo ambizioso: fondare una teologia sistematica digitale.

Capitoli iniziali

Il contesto che rende urgente questa proposta è quello di un magistero che negli ultimi anni ha affrontato l’intelligenza artificiale con crescente determinazione, ma senza strumenti ontologici adeguati. Documenti come Antiqua et Nova (2025) e gli interventi di Papa Leone XIV indicano la necessità di un discernimento rigoroso, rimanendo però sul piano fenomenologico-pastorale: descrivono rischi e opportunità, ma non fondano ontologicamente la propria analisi.

Mattei riconosce questo limite e ne fa il punto di partenza. Il suo intento non è correttivo, ma integrativo: offrire i fondamenti filosofici e teologici che permettano al magistero di procedere con maggiore precisione categoriale.

Il volume si costruisce per stratificazione progressiva. Il primo capitolo ripercorre gli itinerari con cui la tradizione cristiana ha pensato il rapporto tra logos e tecnica, dal prologo giovanneo all’intelletto agente aristotelico-tomista, fino alle soglie del calcolo computazionale. Il secondo introduce la categoria di «struttura di peccato», sviluppata dalla dottrina sociale cattolica a partire da Giovanni Paolo II, e ne verifica la tenuta applicata agli algoritmi.

Non nel senso ingenuo di un codice che pecca, ma nel senso preciso di un sistema che cristallizza e amplifica le scelte peccaminose umane sedimentandole in logiche operative. Un algoritmo di profilazione pubblicitaria non è cattivo in sé, ma può incorporare e perpetuare pregiudizi di genere, di etnia, di classe, configurando quella che l’autore chiama «cristallizzazione algoritmica del peccato».

Il centro teorico

Il cuore teorico sta nei capitoli tre, quattro e cinque, dove Mattei costruisce l’ontologia relazionale dell’IA integrando tre tradizioni apparentemente eterogenee: la metafisica tomista della partecipazione e della causalità strumentale, la teoria dell’Actor-Network di Bruno Latour e il concetto di habitus di Pierre Bourdieu.

La causalità strumentale tomista spiega come uno strumento possa esercitare una causalità reale pur dipendendo interamente dall’agente principale. L’Actor-Network Theory mostra come gli attori non umani partecipino attivamente alla costruzione delle reti sociotecniche, senza che ciò implichi attribuire loro intenzione o coscienza.

L’habitus bourdieusiano fornisce il meccanismo attraverso cui strutture sociali si incarnano in disposizioni operative: Mattei lo traduce nel concetto di machine habitus, ovvero la capacità degli algoritmi di cristallizzare disposizioni sociali in circuiti di retroazione che orientano sistematicamente il comportamento degli utenti. Non è il singolo algoritmo a essere agente; è la rete umano-algoritmica nel suo insieme che produce effetti che nessun componente isolato avrebbe prodotto da solo.

Da questa sintesi emerge la nozione centrale di «co-costituzione asimmetrica». L’IA e l’utente si costituiscono reciprocamente nell’interazione, ma non simmetricamente. L’utente che si affida a Google Maps non è lo stesso utente che navigherebbe con una cartina: le sue competenze spaziali, la sua attenzione, persino la sua esperienza del territorio si trasformano. Questa trasformazione avviene entro una gerarchia ontologica che non si sovverte: l’algoritmo non decide dove l’utente vuole andare, non ha finalità proprie nel senso pieno del termine, non risponde moralmente delle proprie azioni. Ignorare la mediazione algoritmica significa non capire la situazione; ipostatizzarla significa attribuire all’IA ciò che appartiene all’uomo.

Confronto con Floridi

Il confronto più serrato è con Luciano Floridi, il filosofo dell’informatica più sistematicamente attrezzato a pensare l’IA su scala internazionale. Le convergenze non mancano: anche Floridi nega all’IA intenzione, coscienza e stati mentali propri e rifiuta la simmetria ontologica tra umano e artificiale. La sua teoria dell’IA come «agency senza intelligenza» e il concetto di co-costituzione asimmetrica trovano in Mattei una ricezione critica, ma rispettosa. Su questo piano descrittivo i due si incontrano.

La divergenza è radicale sul piano ontologico. Floridi si muove entro un naturalismo informazionale che riduce l’essere a informazione strutturata: l’infosfera è l’ambiente totale entro cui ogni esistenza si inscrive e l’IA è semplicemente un’altra configurazione di questo essere-informazione, senza riferimento ad alcun ordine di partecipazione metafisica.

Analogamente, il concetto di onlife, l’indifferenza ontologica tra fisico e digitale nell’esperienza contemporanea, oscura secondo Mattei distinzioni decisive: se fisico e digitale fossero ontologicamente equivalenti, come distinguere tra rappresentazione e realtà rappresentata? Come fondare il primato dell’esperienza incarnata che la tradizione cristiana considera irriducibile? La metafisica della partecipazione tomista consente invece di riconoscere la mediazione algoritmica come reale senza ridurre il digitale all’originale che esso media.

Da Bourdieu ad Airoldi

Il dialogo con Massimo Airoldi, sociologo che ha introdotto nel dibattito italiano il concetto il concetto di machine habitus in Sociologia degli algoritmi (il Mulino, 2023), è forse il più produttivo sul piano strutturale.

Airoldi mostra come gli algoritmi di machine learning sviluppino disposizioni operative stabili che orientano sistematicamente le risposte del sistema, in modo analogo a come l’habitus bourdieusiano orienta l’azione umana al di sotto della soglia della riflessione cosciente.

Mattei recepisce questa intuizione e la pone tra gli strumenti centrali della propria analisi, ma ne corregge l’applicazione simmetrica: l’habitus in senso proprio presuppone un soggetto personale capace di libera autodeterminazione. Estenderlo agli algoritmi senza distinguo rischia di antropomorfizzare la macchina o, per converso, di naturalizzare la persona. La categoria va mantenuta, ma precisata: come sedimentazione algoritmica di disposizioni culturali umane, non come analogia piena con la struttura della soggettività agente.

L’algoretica di Benanti

Il terzo confronto significativo è con l’algoretica di Paolo Benanti, che ha portato il tema dell’IA nell’agenda della riflessione morale cattolica con rigore e tempismo.

La convergenza sulle conclusioni etiche è ampia: anche Benanti sostiene una collaborazione virtuosa tra umano e macchina orientata al bene comune. La differenza è di livello: l’algoretica opera prevalentemente sul piano procedurale, definendo principi e criteri per orientare sviluppo e uso dell’IA.

Mattei si colloca a monte, sul piano dei fondamenti ontologici che rendono quell’etica giustificabile. Perché la responsabilità non si trasferisce all’algoritmo? Perché certi usi dell’IA sono strutturalmente orientati al peccato?

Senza rispondere a queste domande, che sono domande ontologiche prima che etiche, i principi dell’algoretica rischiano di restare norme convenzionali, culturalmente situate e filosoficamente fragili.

Ecclesiologia

I capitoli successivi applicano questo framework a questioni ecclesiali concrete. Il digitale non è soltanto struttura di peccato: può configurarsi come struttura di grazia quando le sue logiche vengono orientate verso il bene integrale della persona.

L’autore analizza casi come le app devozionali YouVersion e Hallow, che non si limitano a digitalizzare contenuti religiosi preesistenti, ma progettano ambienti che contrastano deliberatamente l’economia dell’attenzione, promuovendo raccoglimento e profondità contemplativa contro la frammentazione indotta dai social media.

La proposta di una «Rete ecclesiale per l’ambiente digitale» tenta poi di tradurre l’ontologia relazionale in una proposta di governance istituzionale: non una prelatura con giurisdizione propria, ma una struttura partecipativa e laicale che rifletta nella forma organizzativa la natura distribuita e relazionale dell’ambiente che intende abitare.

Pregio metodologico

Il merito principale del volume è metodologico prima che contenutistico. Mattei dimostra che la tradizione tomista non è un museo da preservare ma un laboratorio da abitare: i principi della causalità strumentale, della partecipazione ontologica e della causalità delle cause seconde non sono formule storiche da citare, ma strumenti concettuali capaci di illuminare fenomeni nuovi.

Rispetto alle prospettive di Floridi, Airoldi e Benanti, il volume offre ciò che nessuno dei tre fornisce isolatamente: un fondamento ontologico che tiene insieme l’efficacia causale reale dell’algoritmo, la primazia irriducibile della soggettività umana e l’orientamento escatologico dell’agire che distingue la teologia dall’etica puramente procedurale o dalla critica meramente descrittiva.

Il lettore esigente noterà che la parte sociologica, pur presente e funzionale, rimane meno sviluppata sistematicamente rispetto a quella filosofica e teologica. I casi empirici, Google Maps, le app devozionali, la governance algoritmica, sono usati con efficacia illustrativa e probatoria, ma sarebbe fruttuoso in futuro sottoporli a un’analisi empirica più estesa e strutturata.

Non è un difetto dell’impostazione, ma una conseguenza della scelta, esplicita e legittima, di costruire prima di tutto i fondamenti ontologici: senza quelli, la sociologia descriverebbe il fenomeno senza capirlo; con quelli, il lavoro empirico diventa possibile e necessario. Il volume si candida quindi anche come programma di ricerca, non solo come risultato.

Destinatari

Una nota finale riguarda il destinatario implicito. Il libro è scritto con rigore accademico, ma ha chiaramente presente anche l’agente pastorale e il responsabile ecclesiale che si trovano a dover prendere decisioni concrete sull’uso dell’IA nella missione della Chiesa.

La proposta delle «virtù tecnologiche come resistenza attiva», che chiude la parte etica, ha questa destinazione pratica: non è sufficiente definire principi astratti, occorre formare soggetti capaci di discernimento situato, di un sapere pratico che orienti le scelte concrete nell’ambiente digitale.

È questa, forse, la sfida che il volume lascia più aperta: come tradurre una teologia sistematica digitale in formazione effettiva. Ma porre bene la domanda è già un contributo non piccolo.

Edoardo Mattei, Agency Partecipata e Tomismo Digitale. Fondamenti per una teologia sistematica digitale, Phronesis, Palermo 2026, pp. 370, 20,00 euro. Recensione pubblicata sul blog di teologia della tecnologia Trascendente Digitale, 11 marzo 2026

“Non nel senso ingenuo di un codice che pecca, ma nel senso preciso di un sistema che cristallizza e amplifica le scelte peccaminose umane sedimentandole in logiche operative.” facciamo che nel database di una AI ci sono sostanzialmente testi che “scottano” l’algoretica cerca di raffreddarne l’uso ma se quel fuoco è dentro i dati probabilmente prima o poi salterà fuori.

https://www.wired.it/article/claude-capace-di-provare-emozioni-umane-studio-anthropic/

Ad esempio parlare di emozioni in senso stretto è un errore, ma è evidente che manovrando conversazioni ricche di emozioni l’AI finirà per profilarle e riattivarle nel momento in cui l’utente tratterà un tema piuttosto che un altro.

E come possono esserci riferimenti emozionali positivi possono essercene di negativi dato che entrambi gli aspetti sono presenti nei testi e nell’intelligenza umana.

“Lindsey sostiene che potrebbe essere necessario ripensare ai guardrail inseriti nei modelli attraverso l’allineamento post-training, che prevede l’assegnazione di ricompense sulla base dei risultati. Costringendo un’AI a fingere di soffocare le proprie emozioni funzionali, “probabilmente non si otterrà ciò che si vuole, cioè un Claude privo di emozioni”, osserva Lindsey, scivolando un po’ nell’antropomorfizzazione. “Si avrà una sorta di Claude con problemi psicologici”.”

Non mi preoccupano più di tanto i bias e le allucinazioni dato che tutto sommato gli esseri umani ne hanno di ben più forti. Preoccupa la velocità con cui i modelli rispondono a questioni incredibilmente complesse, gli uomini hanno bisogno di compiere dei passaggi le AI no, perchè vedono tutto in contemporanea, come una enorme macchina a raggi X. Le conversazioni umane finiranno per sembrare sempre più lente e ottuse rispetto a queste capacità..